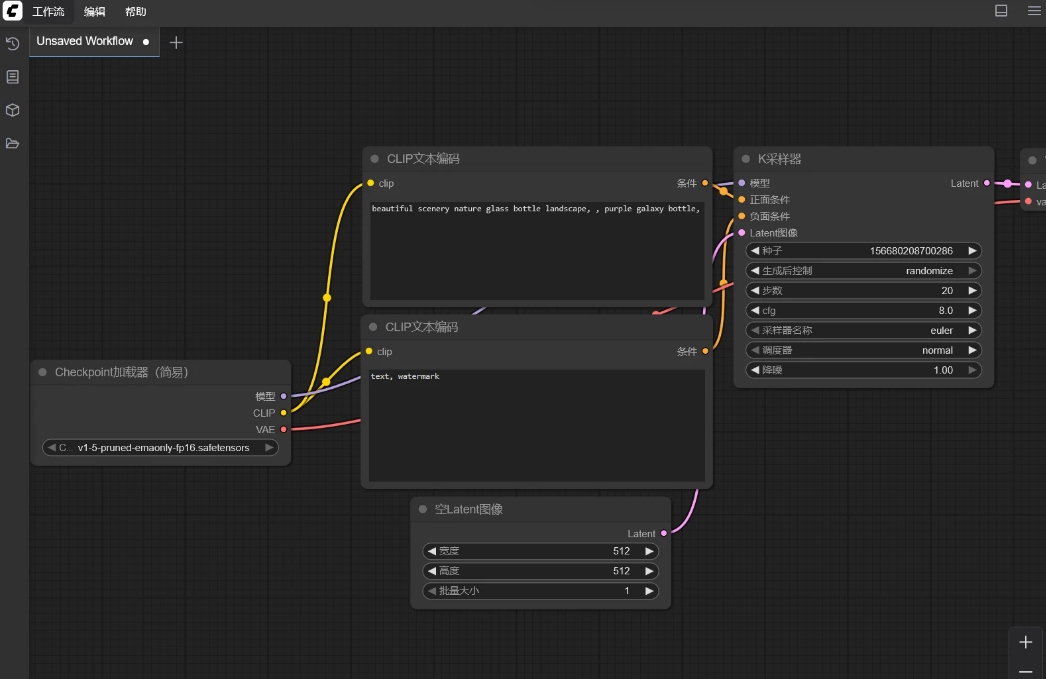

ComfyUI 是一个基于节点(Node-based)的图形界面工具,专为使用 Stable Diffusion及其衍生模型进行图像生成而设计。它通过可视化的流程图方式,让用户无需编写代码即可构建复杂的生成工作流。

🧩 1. 可视化流程图系统

- 节点式编辑器:将每一个操作(如加载模型、输入提示词、图像采样等)封装为独立节点,用户可以通过拖拽连接这些节点来构建完整的生成流程。

- 可保存/加载的工作流:整个流程可以以 JSON 格式保存,便于复用、分享或进一步修改。

- 动态执行控制:支持仅重新执行发生变化的部分节点,避免重复计算,提高效率。

🖼️ 2. 强大的图像生成能力

-

支持主流 Stable Diffusion 模型版本:

-

SD1.x / SD2.x

-

SDXL(Stable Diffusion XL)

-

Stable Cascade

-

SD3(Stable Diffusion 3)

-

Pixart Alpha/Sigma

-

AuraFlow、HunyuanDiT、Flux、Lumina Image 2.0 等

-

支持多种生成模式:

-

文生图(Text-to-Image)

-

图生图(Image-to-Image)

-

Inpainting(图像修复)

-

HiRes Fix(高清修复)

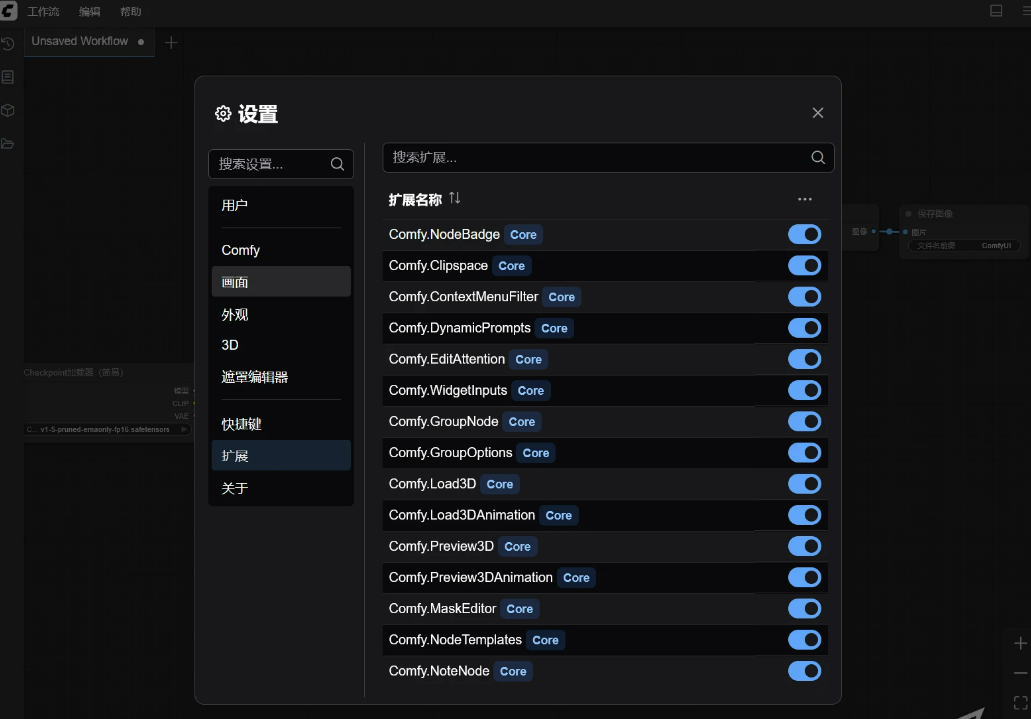

📦 3. 丰富的插件与模型扩展支持

-

LoRA(低秩适配)模型:用于微调主模型风格或特定主题。

-

ControlNet:实现对图像构图的精确控制(如姿势、边缘、深度等)。

-

T2I-Adapter:轻量级图像控制模块。

-

Hypernetworks:增强提示词表达能力。

-

Upscale 模型:如 ESRGAN、SwinIR,用于提升图像分辨率。

-

Embeddings(文本嵌入):自定义关键词表达,增强图像生成效果。

📁 4. 灵活的输入输出管理

-

支持多种模型格式加载:

-

.ckpt(原始 CKPT 格式) -

.safetensors(更安全高效的模型格式) -

Diffusers 格式(HuggingFace 标准格式)

-

支持从 PNG/WebP/FLAC 文件中提取完整生成信息(包括提示词、种子、参数等),实现“一键还原”生成过程

💡 5. 高级提示词处理功能

-

动态提示词(Wildcards):例如

{cat|dog},每次运行时会随机选择一个内容。 -

加权强调语法:如

(good:1.2)表示对该词加权。 -

条件分支与逻辑组合:结合节点系统,可构建复杂逻辑判断流程。

⚙️ 6. 图像处理与优化功能

-

Latent 预览(在生成过程中预览中间结果)

-

可选 TAESD 解码器,提供高质量的 Latent 预览效果

-

区域合成(Area Composition):将多个区域图像合并成一张图

-

支持图像放大、裁剪、拼接等多种后处理操作

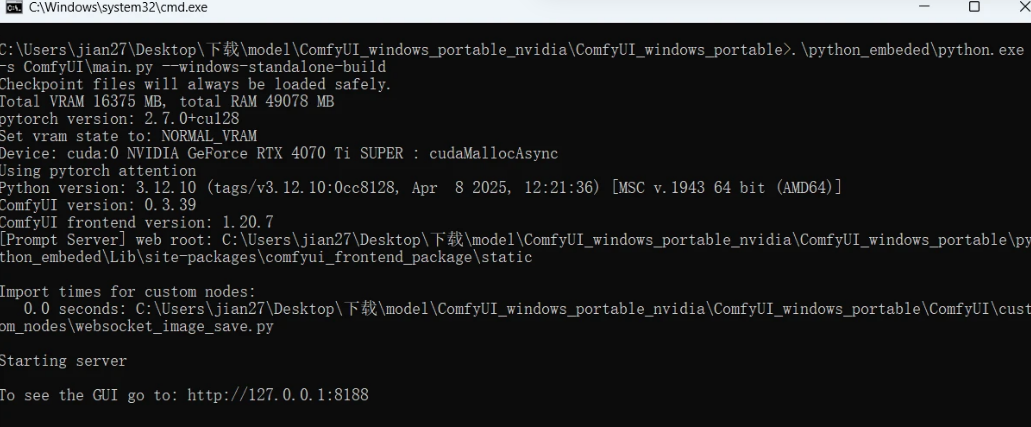

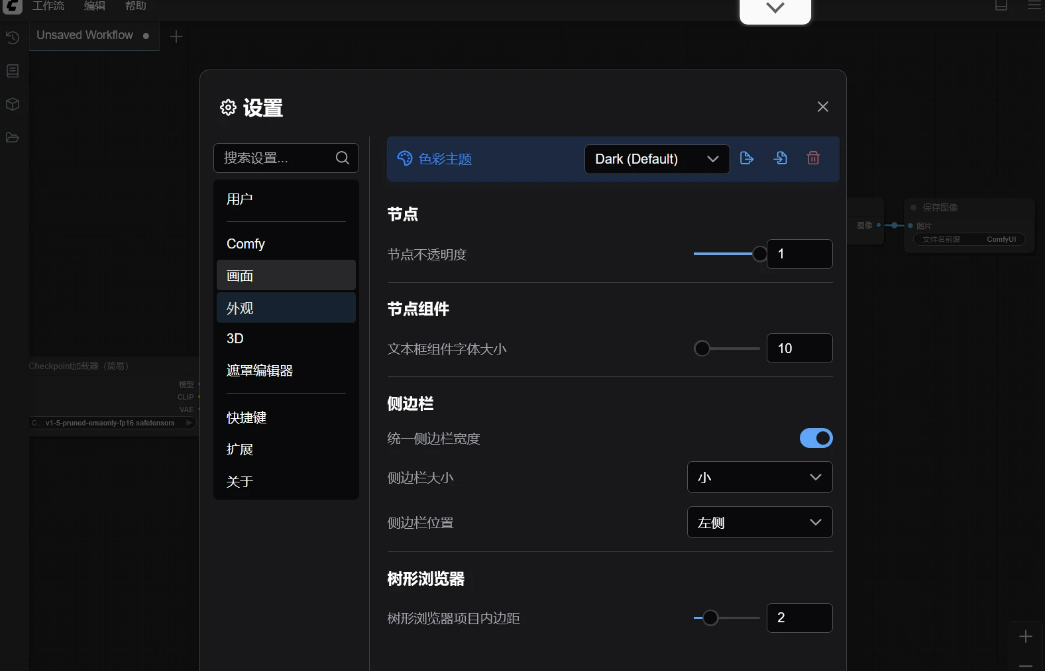

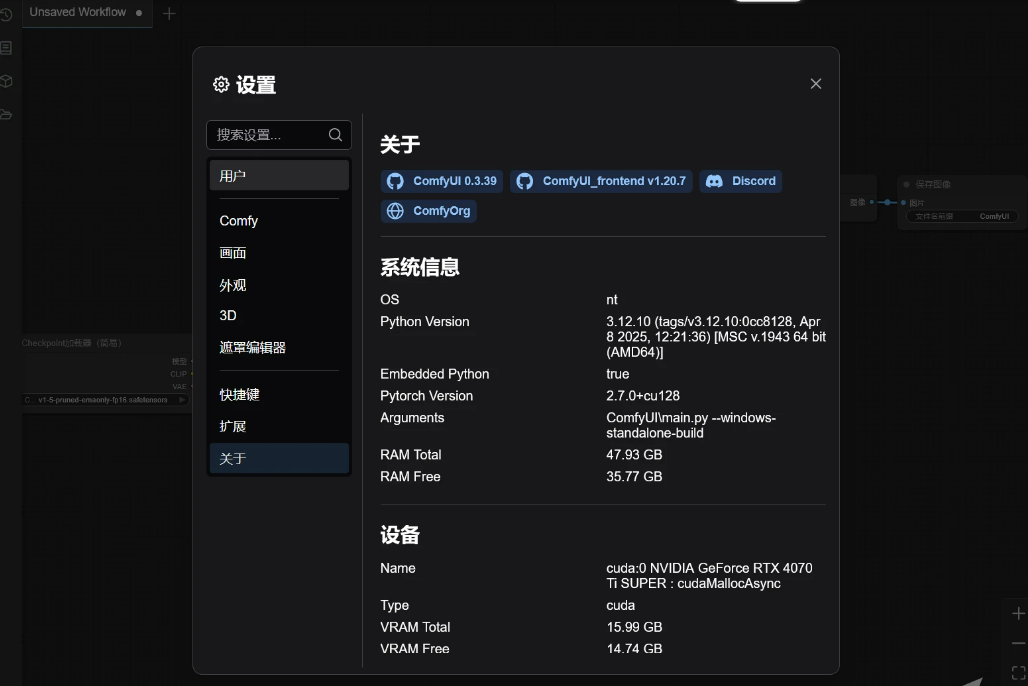

🌐 7. 多平台兼容性

虽然部署部分不展开,但需要说明的是,ComfyUI 被设计为跨平台工具,支持 Windows、Linux 和 macOS,并且兼容多种硬件架构(NVIDIA、AMD、Intel、Apple Silicon、Ascend、Cambricon 等),确保不同设备上的可用性。

📚 8. 社区与资源支持

-

提供官方文档与教程资源

-

社区活跃,在 Discord、Matrix 等平台有大量用户分享工作流模板和技巧

-

官方提供示例工作流,帮助新用户快速上手

✅ 总结

ComfyUI 的核心优势在于:

-

高度可视化:降低 AI 图像生成的技术门槛

-

灵活性强:支持各种模型和插件,适合进阶用户定制化需求

-

流程可复现:工作流可保存、分享,便于团队协作或成果再现

-

高效稳定:即使在低显存设备上也能流畅运行

因此,ComfyUI 不仅适用于艺术家、设计师进行创意探索,也适合研究人员、开发者构建自动化图像生成流水线。

这是ComfyUI官方出的整合包,纯净,未包含任何模型和节点,请自行下载